Automatizar sin control

Lo que conviene saber antes de instalar OpenClaw u otro asistente automático para el trabajo.

Introducción

La nueva generación de asistentes ya no se limita a responder preguntas o a redactar un texto. Algunos pueden leer correos, revisar documentos, abrir páginas, resumir conversaciones, mover información entre servicios y ejecutar acciones encadenadas. Ahí está su atractivo y también su riesgo.

OpenClaw encaja en esa categoría: se presenta como un asistente personal de código abierto, pensado para funcionar de forma local, conectarse a canales y ampliar capacidades mediante herramientas y skills [OpenClaw, 2026]. Visto desde fuera, parece una ayuda práctica para ahorrar tiempo. Y, en muchos casos, lo es.

El problema empieza cuando alguien lo instala por su cuenta y lo conecta a correo, ficheros, mensajería o navegadores sin una revisión previa. En ese momento deja de ser solo una herramienta personal. Pasa a convertirse en un nuevo punto de acceso al trabajo diario, con permisos, memoria y capacidad de actuar.

En un entorno universitario esto merece especial cuidado. Aquí conviven docencia, investigación, expedientes, tutorías, convocatorias, bibliotecas, movilidad, gestión y trabajo híbrido. La misma automatización que hoy ahorra diez minutos puede mañana mezclar datos que nunca debieron coincidir en el mismo flujo. No se trata de frenar estas herramientas, sino de usarlas con límites claros desde el principio.

Qué es OpenClaw y por qué importa

Un agente automático no es simplemente un chat con mejor redacción. La diferencia importante es que no solo conversa: también puede actuar. Puede conservar contexto entre sesiones, recibir instrucciones desde varios canales, leer contenido externo, usar herramientas del sistema y encadenar tareas con cierta autonomía [OpenClaw, 2026; AEPD, 2026].

Eso tiene ventajas reales. Puede ayudar a preparar borradores, localizar información dispersa, resumir mensajes largos, convertir formatos, ordenar pendientes o servir como apoyo en tareas repetitivas. En momentos de prisas, plazos y multitarea, esa promesa resulta muy tentadora.

Pero la misma capacidad que lo hace útil amplía la superficie de exposición. Si el agente entra en el correo, no ve solo el mensaje del día: puede ver hilos anteriores, adjuntos, calendarios y contactos. Si entra en carpetas compartidas, puede leer más de lo estrictamente necesario. Si navega, puede encontrarse con instrucciones engañosas dentro de una página o un documento. Y si además tiene permisos de escritura, el error ya no se queda en la pantalla de quien lo instaló: se propaga.

Por eso importa tanto. No porque OpenClaw u otro agente sea inseguro por definición, sino porque cambia la escala del acceso. Reduce fricción, acelera tareas y hace más cosas con menos intervención humana. Justamente por eso necesita más criterio previo, no menos.

Qué se ve desde fuera: señales útiles y límites

Cuando un agente se instala sin control, a veces deja señales visibles. Aparecen integraciones que nadie había pedido, conexiones nuevas a servicios corporativos, resúmenes demasiado amplios, borradores que mezclan asuntos distintos o respuestas enviadas con un tono extraño y uniforme. En otras ocasiones se detectan accesos a carpetas antiguas, reglas nuevas en el correo o automatizaciones que “hacen demasiado” para lo poco que, en teoría, debían hacer.

También hay pistas más sutiles. Un documento que incorpora datos de otra unidad, un asistente que recuerda cosas que no debería recordar, una consulta que parece inocente pero devuelve información cruzada, o una herramienta que pide permisos muy amplios para una tarea muy concreta. Nada de eso prueba por sí solo un incidente, pero sí invita a revisar.

Ahora bien, conviene no confiarse ni dramatizar. La ausencia de síntomas no significa que todo esté bien, y un comportamiento raro no implica siempre una brecha. A veces solo hay una mala configuración; otras veces hay un problema más serio. Lo prudente es tratar estas señales como indicios, no como certezas, y comprobar permisos, alcance y trazabilidad antes de seguir usándolo.

Qué ocurre por dentro

Por dentro, estos asistentes suelen combinar cuatro piezas. La primera son las cuentas y permisos: con qué identidad entra el agente en correo, almacenamiento o mensajería. La segunda es la memoria: qué conserva entre una sesión y otra. La tercera son las herramientas: leer, escribir, buscar, abrir páginas o ejecutar acciones. Y la cuarta son las entradas: mensajes, documentos, enlaces, páginas y adjuntos que el agente interpreta para decidir qué hacer.

Hay un detalle importante que suele pasar desapercibido. En la propia documentación de seguridad de OpenClaw se recuerda que la sesión sirve para enrutar contexto, pero no debe confundirse con una frontera de autorización por usuario [OpenClaw Security, 2026]. Dicho de forma sencilla: que una conversación esté separada no significa, por sí solo, que los permisos estén bien separados.

También importa mucho la fuerza del modelo que hay detrás. OpenClaw advierte de que los modelos más pequeños o más débiles son más vulnerables a instrucciones engañosas y a usos indebidos de herramientas cuando leen contenido no fiable [OpenClaw Security, 2026]. Es una idea poco vistosa, pero muy práctica: abaratar el modelo puede salir caro si ese agente toca correo, ficheros o red.

Correo y adjuntos. Desde fuera, parece una ayuda inocente: ordenar la bandeja, localizar mensajes o resumir conversaciones largas. Por dentro, el agente puede estar leyendo adjuntos, metadatos, hilos antiguos y enlaces, incluidas cadenas con información sensible. La respuesta sensata no es prohibir el correo por defecto, sino limitar buzones, dejar solo lectura cuando baste y revisar con cuidado qué información queda a su alcance.

Documentos y carpetas. Desde fuera, parece que el asistente “mira una carpeta”. Por dentro, si la conexión está mal definida, puede heredar acceso a espacios más amplios, cruzar documentos de distintos contextos o mantener memoria de contenidos que no deberían mezclarse. La medida útil aquí es muy concreta: accesos mínimos, espacios separados y nada de permisos generales por comodidad.

Navegación y acciones web. Desde fuera, se ve rapidez: abrir una página, recopilar datos, rellenar un formulario o seguir una instrucción. Por dentro, el navegador del agente puede encontrarse con contenido manipulado para desviar la tarea o provocar acciones no previstas. La propia documentación de OpenClaw insiste en que la protección real no depende solo de un mensaje de sistema, sino de políticas de herramientas, aprobaciones, aislamiento y listas de permitidos [OpenClaw Security, 2026].

Skills, conectores y extensiones. Desde fuera, se instalan como complementos cómodos. Por dentro, cada skill añade dependencias, permisos y nuevas rutas de entrada y salida. OWASP ya lo plantea así para aplicaciones agénticas: inventario, mínimo privilegio, revisión de componentes, auditoría de acciones y reducción del radio de impacto [OWASP, 2026]. En la práctica, un agente no suele volverse problemático por una gran decisión aislada, sino por muchas pequeñas ampliaciones aceptadas sin pensar demasiado.

Qué está en juego en la Universidad

Lo que está en juego no son solo “documentos de trabajo”. Pueden verse afectados expedientes, actas, tutorías, información de biblioteca, trámites de movilidad, comunicaciones con estudiantes, convocatorias, proyectos de investigación, documentación económica y datos de personal. Además, buena parte de ese trabajo circula entre correo institucional, plataformas en la nube, acceso remoto, dispositivos personales y redes distintas según el lugar desde el que se trabaje.

Ahí es donde estos agentes cambian el equilibrio. Muchas barreras de seguridad no eran solo técnicas; también eran prácticas. Antes costaba más reunir en un mismo flujo un correo, un documento, una carpeta compartida y una acción posterior. Ahora puede hacerlo un agente en segundos. Esa reducción de fricción es precisamente lo que lo hace útil. Y, a la vez, lo que obliga a pensar mejor los límites.

La AEPD lo ha señalado de forma expresa en sus orientaciones sobre IA agéntica: estos sistemas no solo responden, también interactúan con autonomía, se enriquecen con información del entorno digital y ejecutan tareas complejas, lo que plantea nuevos retos en protección de datos [AEPD, 2026]. En otras palabras: no basta con preguntarse si la herramienta funciona. Hay que decidir si debe acceder a esos datos, con qué alcance y bajo qué supervisión.

Cómo ayuda el STIC

La mejor ayuda no suele llegar cuando ya hay un problema grande, sino antes. El STIC puede ayudar a revisar si el caso de uso tiene sentido, qué datos necesita realmente el agente, si basta con lectura, si conviene separar entornos, qué permisos sobran, cómo revocar accesos y qué trazas deben existir para saber qué ha hecho.

Si el agente ya estaba conectado, la ayuda pasa por contener y ordenar: retirar permisos, revisar integraciones, acotar carpetas, invalidar sesiones, valorar cambios de credenciales, dejar claro qué se mantiene y qué se desactiva. No hace falta prometer soluciones milagrosas. A menudo, la diferencia entre un susto y un problema serio está en avisar pronto.

También hay una función menos visible y muy útil: convertir una ocurrencia individual en un proceso más seguro para todos. Cuando un caso de uso es razonable, se puede reconducir. Cuando no lo es, conviene cerrarlo con criterio. En ambos casos, lo importante es que la decisión no dependa solo del entusiasmo de quien encontró una herramienta nueva.

Lo que ha cambiado en 2026

En poco tiempo, la conversación ha pasado de “usar IA para redactar” a “usar IA para actuar”. Ese cambio es más profundo de lo que parece. Un sistema agéntico no se limita a generar texto: interpreta objetivos, consulta fuentes, toma decisiones intermedias y ejecuta pasos. Eso obliga a mirar no solo el modelo, sino todo el conjunto: permisos, memoria, canales, herramientas y datos de entrada.

La AEPD ha dedicado en 2026 una guía específica a la IA agéntica desde la perspectiva de protección de datos, con atención expresa a vulnerabilidades, amenazas y medidas de control [AEPD, 2026]. OWASP ha publicado su Top 10 para aplicaciones agénticas, con un enfoque claramente operativo [OWASP, 2026]. Y NIST sigue proponiendo un marco útil para gestionar los riesgos de la IA generativa alineando objetivos, contexto y controles a lo largo del ciclo de vida [NIST, 2024].

Hay además una idea que conviene retener porque afecta al día a día. OpenClaw no trata la inyección de instrucciones engañosas como un problema resuelto por arte de magia: insiste en que los enlaces, adjuntos, documentos y resultados web deben tratarse como contenido no confiable por defecto, y en que el aislamiento y las políticas de herramientas son lo que de verdad limita el daño [OpenClaw Security, 2026]. Esa visión es bastante más útil que la falsa tranquilidad de pensar que “si es mi agente, lo que lee ya es seguro”.

CISA lo resume desde otro ángulo: la seguridad de los datos condiciona la exactitud, la integridad y la fiabilidad de los resultados de IA [CISA, 2025]. No es solo una cuestión de confidencialidad. Si los datos que el agente recibe, mezcla o interpreta no están bien protegidos, también se resiente la calidad de lo que devuelve.

Datos recientes en contexto

No hay un estudio público reciente y específico que permita decir cuántas personas están instalando OpenClaw por su cuenta en universidades españolas. Conviene decirlo así de claro. Lo que sí puede observarse es la velocidad con la que está creciendo este tipo de ecosistema.

- El repositorio público de OpenClaw mostraba alrededor de 362.000 estrellas y 74.000 forks, una señal de difusión muy alta para una herramienta de este tipo [OpenClaw, 2026].

- En la misma página figuraban 102 releases y 1.726 contribuyentes, lo que apunta a un desarrollo intenso y continuo [OpenClaw, 2026].

- La documentación visible del proyecto enumeraba 26 canales compatibles, desde mensajería hasta servicios de colaboración, lo que explica bien su atractivo y también su complejidad [OpenClaw, 2026].

- La guía de la AEPD sobre IA agéntica se publicó el 18 de febrero de 2026, señal clara de que el debate ya está en fase de gobernanza, no solo de experimentación [AEPD, 2026].

Estas cifras describen el tamaño del fenómeno, no el nivel real de exposición en una organización concreta. Aun así, bastan para entender que ya no estamos ante una herramienta marginal o anecdótica.

Checklist en 30 segundos

- No conectes un agente a servicios institucionales por tu cuenta. Porque el riesgo real no está en probarlo, sino en los permisos que puede conservar después.

- Empieza por un caso de uso pequeño y claro. Porque “que haga de todo” suele ser la forma más rápida de darle acceso de más.

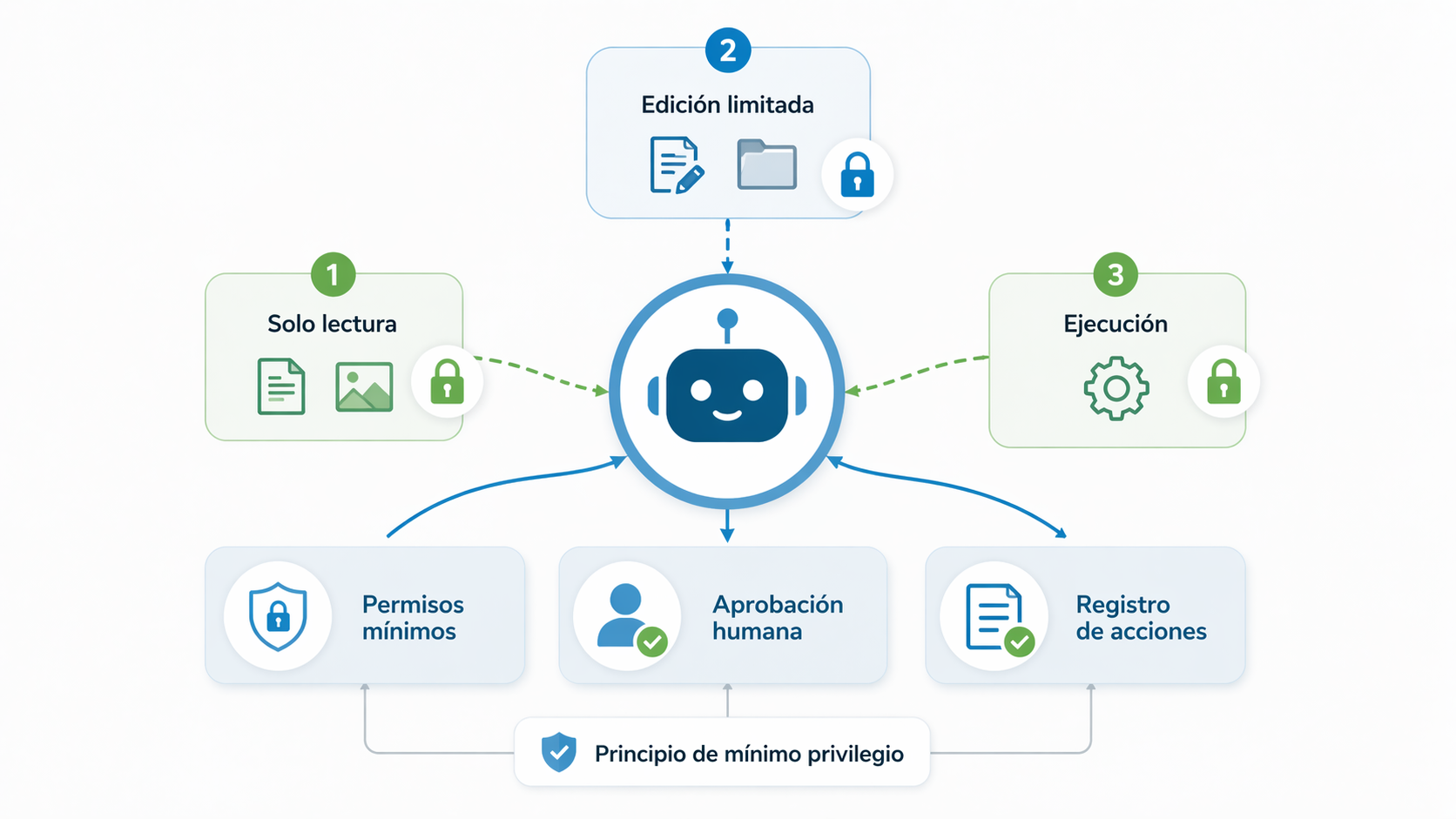

- Da solo lectura cuando sea suficiente. Porque leer ya aporta mucho valor y reduce bastante el impacto de un error.

- Separa tu cuenta personal de la identidad del agente. Porque así es más fácil revocar, auditar y entender qué hizo cada uno.

- Limita carpetas, buzones y canales al mínimo. Porque un acceso amplio por comodidad termina casi siempre en una exposición innecesaria.

- Desconfía de skills y conectores no revisados. Porque cada complemento añade dependencias, código y nuevas rutas de acceso.

- No dejes al agente leer contenido no confiable sin límites. Porque enlaces, adjuntos y páginas pueden contener instrucciones engañosas aunque parezcan normales.

- No uses modelos débiles para agentes con herramientas. Porque son más propensos a desviarse cuando tienen que leer y actuar a la vez.

- Exige registro de acciones y forma de parada. Porque lo que no se puede revisar ni detener a tiempo se gobierna mal.

- Revisa permisos y accesos cada cierto tiempo. Porque muchos problemas nacen de integraciones antiguas que nadie retiró.

Qué hacer si ya ha pasado

Si ya se ha instalado un agente o sospechas que uno está conectado a servicios de trabajo sin la revisión adecuada, lo primero es parar. No conviene seguir probando “para ver si falla”. Tampoco conviene borrar deprisa y sin revisar. Lo sensato es detener automatizaciones, desconectar las integraciones recientes y evitar que el agente siga leyendo o escribiendo mientras se comprueba el alcance.

Después, toca mirar lo básico: a qué correo entraba, qué carpetas veía, qué servicios tenía conectados, si podía solo leer o también escribir, y si usaba una cuenta personal para entrar en sistemas institucionales. Con esa información ya se puede decidir si hay que revocar accesos, cerrar sesiones o cambiar credenciales.

También ayuda guardar un pequeño contexto: qué herramienta era, cuándo se instaló, para qué se estaba usando y qué comportamiento raro se observó. No hace falta entender todos los detalles técnicos para avisar bien. De hecho, esperar a tener una explicación perfecta suele retrasar lo que más ayuda: comunicarlo pronto.

Privacidad y trato respetuoso

Conviene recordar algo importante: muchas de estas instalaciones no nacen de la mala fe, sino de la prisa, la curiosidad o la presión por hacer más con menos tiempo. Eso no quita importancia al riesgo, pero sí debería marcar el tono de la respuesta. Lo útil es corregir, contener y aprender.

La proporcionalidad importa. Si hay que revisar un caso, debe hacerse con confidencialidad, con el menor número posible de personas y sin exponer detalles identificables de quien cometió el error o de quienes puedan verse afectados. Un incidente bien gestionado no es solo el que se cierra rápido, sino el que deja un criterio mejor para el siguiente caso.

La propia AEPD insiste en esa idea de fondo: cuando una organización introduce IA agéntica, necesita gobernanza, supervisión y medidas pensadas para esa forma concreta de tratar datos, no una simple adaptación superficial de reglas antiguas [AEPD, 2026].

Cierre

OpenClaw y otros agentes automáticos pueden ser útiles. De hecho, su utilidad es evidente: ahorran tiempo, reducen tareas repetitivas y ayudan a manejar mejor la carga diaria. El problema no está en querer esa ayuda. Está en olvidar que, para ayudar de verdad, primero necesitan acceso. Y todo acceso necesita límites.

La mejor protección no pasa por el rechazo automático ni por el entusiasmo sin freno. Pasa por hacer unas pocas cosas bien: definir el caso de uso, reducir permisos, separar identidades, desconfiar de conectores y contenidos externos, dejar trazas y mantener supervisión humana cuando toca.

Eso no frena la innovación. La ordena. Y, en este tema, ordenar suele ser la forma más sensata de seguir avanzando.

Un agente útil no es el que más puede hacer, sino el que hace solo lo que debe, donde corresponde y con el acceso mínimo necesario.